11월 13일

Backoffice AI Agent 구축기 — RAG+MCP 기반 플레이스AI 특화 지식 검색 시스템

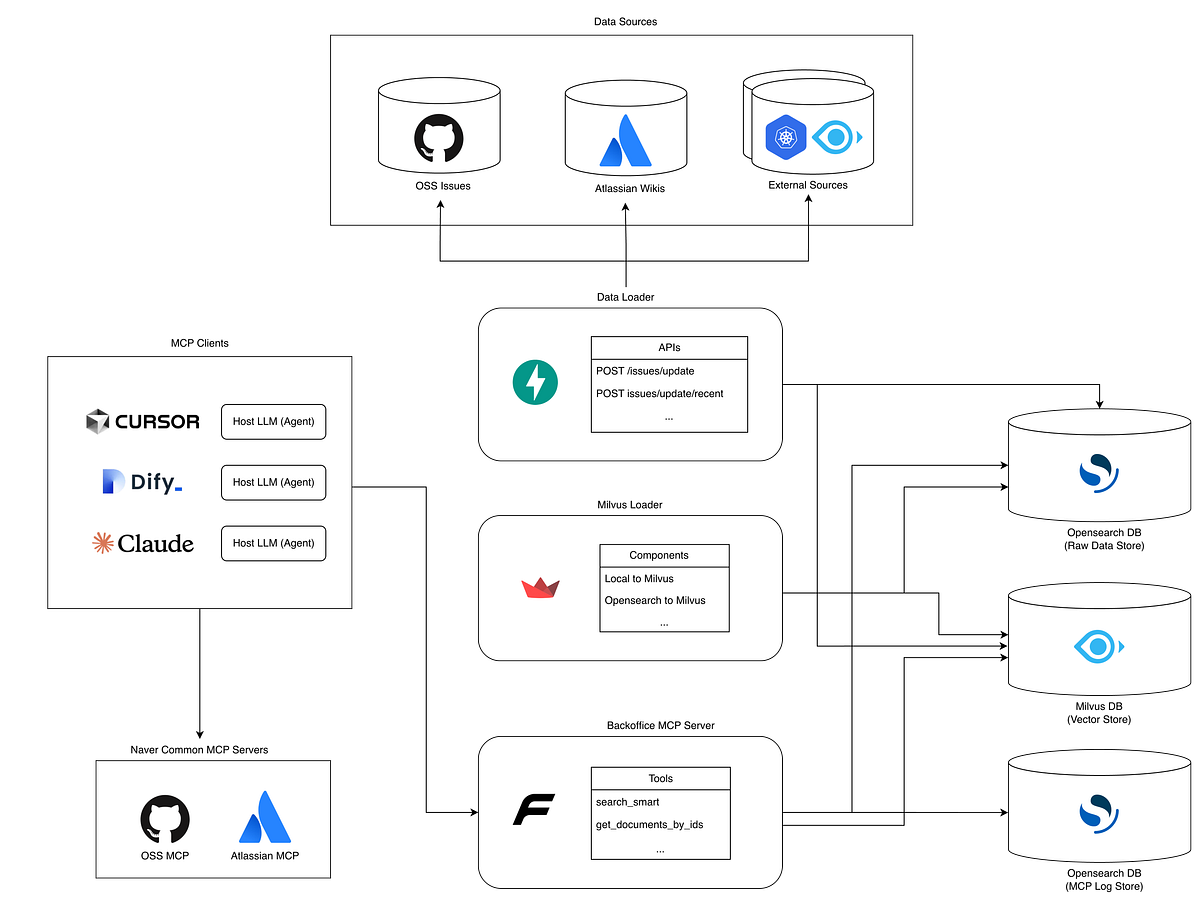

플레이스AI 팀은 RAG+MCP 기반의 의미검색 에이전트를 구축해 사내 문서 탐색 효율을 크게 향상시켰습니다. 평가 결과 기존 검색 대비 응답 만족도와 속도가 크게 개선되었고, 토큰 사용과 툴 호출이 절감되었습니다.

11월 13일

플레이스AI 팀은 RAG+MCP 기반의 의미검색 에이전트를 구축해 사내 문서 탐색 효율을 크게 향상시켰습니다. 평가 결과 기존 검색 대비 응답 만족도와 속도가 크게 개선되었고, 토큰 사용과 툴 호출이 절감되었습니다.

11월 26일

YARN 환경에서 운영되는 Trino 클러스터의 리소스 설정을 최적화하여 장비 증설 없이 가용 메모리를 약 40% 증가시켰습니다. 주요 설정 조정과 RESERVED Resource 이해를 통해 안정적이고 효율적인 클러스터 운영 방안을 제시합니다.

10월 2일

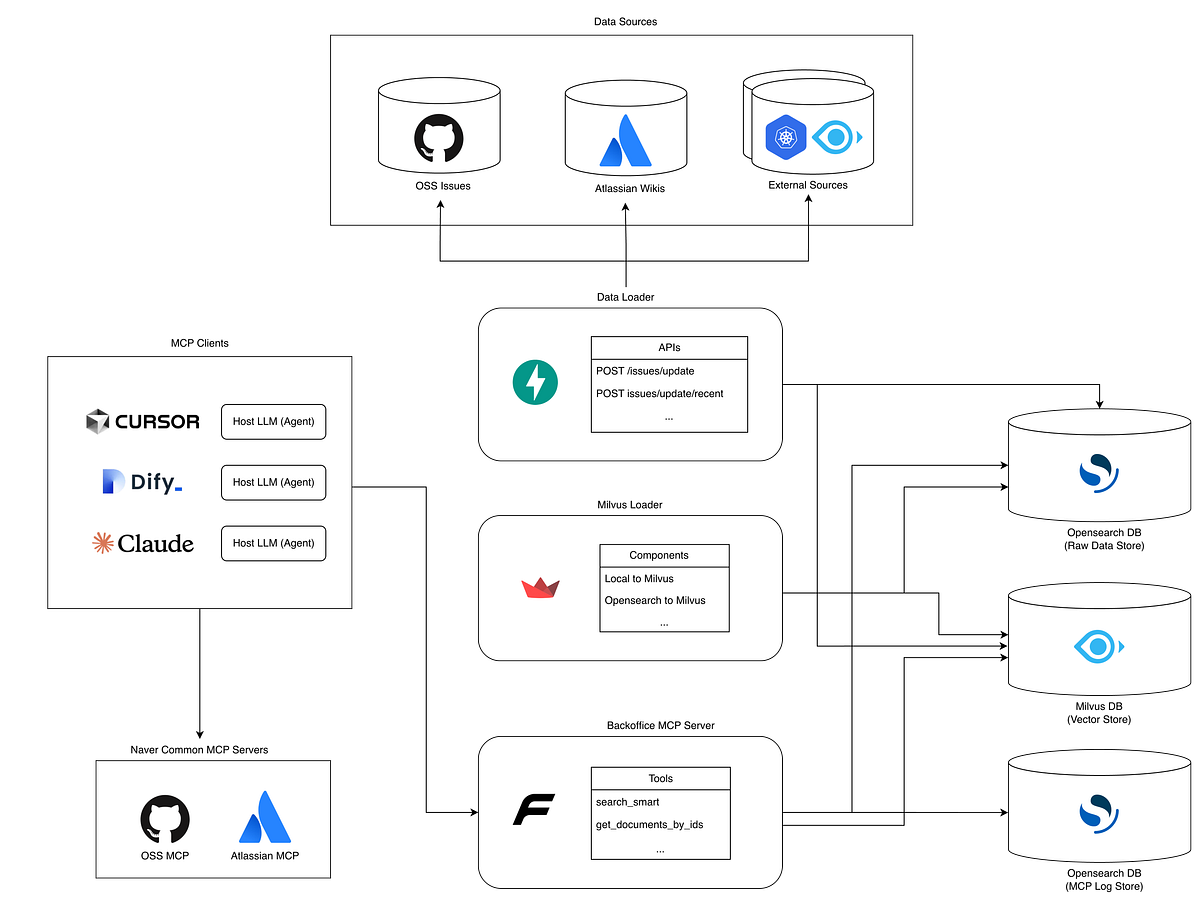

네이버 지도는 수치지형도와 거리뷰 이미지를 활용해 좁은 도로를 탐지하는 모델을 개발했습니다. 이미지 기반 semantic segmentation 기법이 더 정확한 도로 너비 추정을 가능하게 하여 내비게이션 품질을 향상시켰습니다.

12월 14일

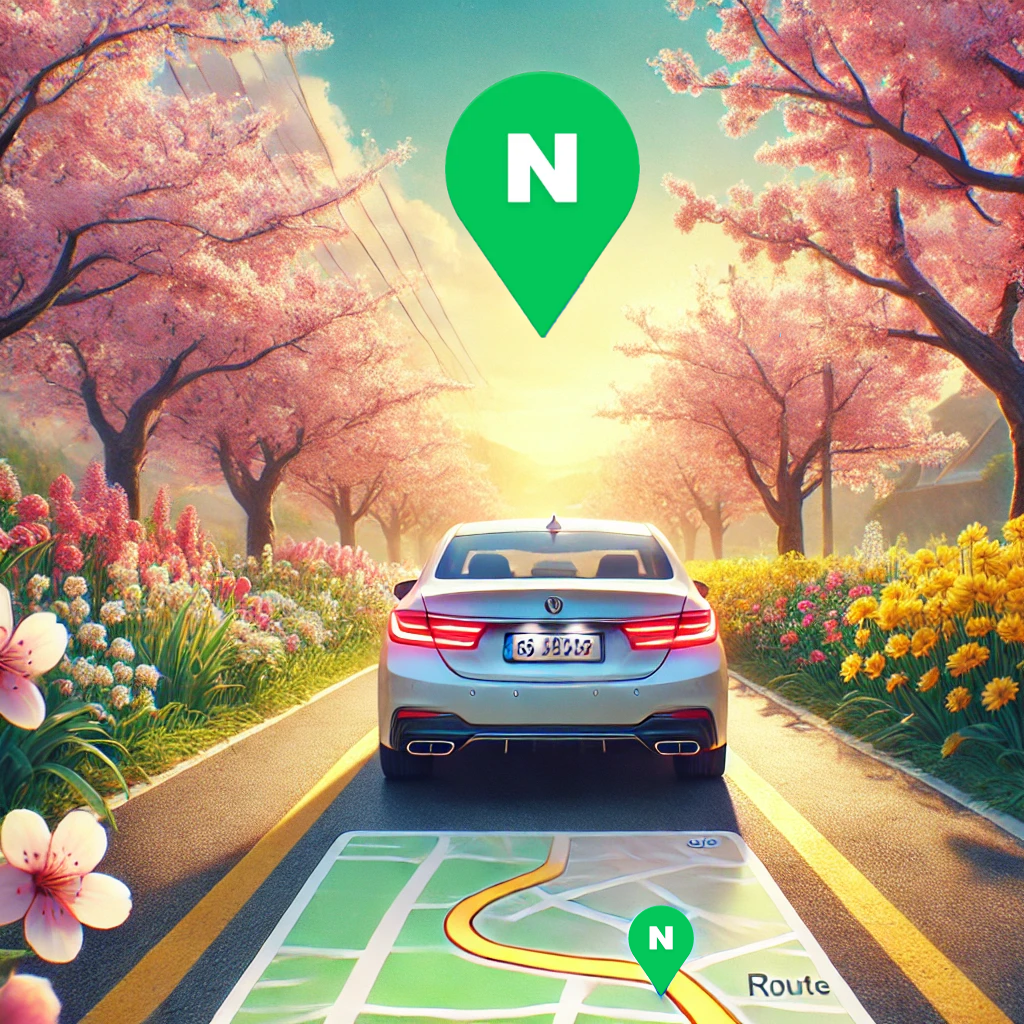

Airflow에서 동일한 DAG 내 실패한 여러 Task의 Alert 메일을 하나로 통합하는 방법을 소개합니다. 이를 통해 불필요한 알림 폭탄을 줄이고, 실패 로그를 메일 본문에 포함해 문제 대응을 쉽고 효율적으로 할 수 있습니다.

12월 4일

이 글은 Apache Airflow를 Docker Compose로 컨테이너화하여 개발과 배포 환경의 일관성을 확보하는 방법을 소개합니다. 또한 Pycharm과 연동해 효율적인 DAG 개발 및 디버깅 환경을 구축한 경험을 공유합니다.

11월 6일

네이버 플레이스 리뷰 태깅 시스템을 재설계하여 태그 업데이트 부하를 67% 줄이고 운영 효율성을 대폭 개선했습니다. 분석값 저장소 분리와 write buffer 도입으로 빈번한 DB 업데이트 문제를 해결했습니다.

9월 8일

NAVER GLACE CIC AI 개발팀은 다양한 NLP와 컴퓨터 비전 모델을 활용해 한국과 일본의 O2O 서비스를 지원합니다. PlaceLM LLM 개발과 자동화된 모델 운영으로 고성능 AI 서비스를 지속적으로 제공하고 있습니다.

7월 13일

GPU 기반 ML 모델 서버를 CPU 서버로 전환하며 성능 저하 없이 서비스 품질을 유지했습니다. 최적화 작업과 모델 경량화를 통해 연간 약 4억원의 비용을 절감하는 성과를 달성했습니다.

6월 7일

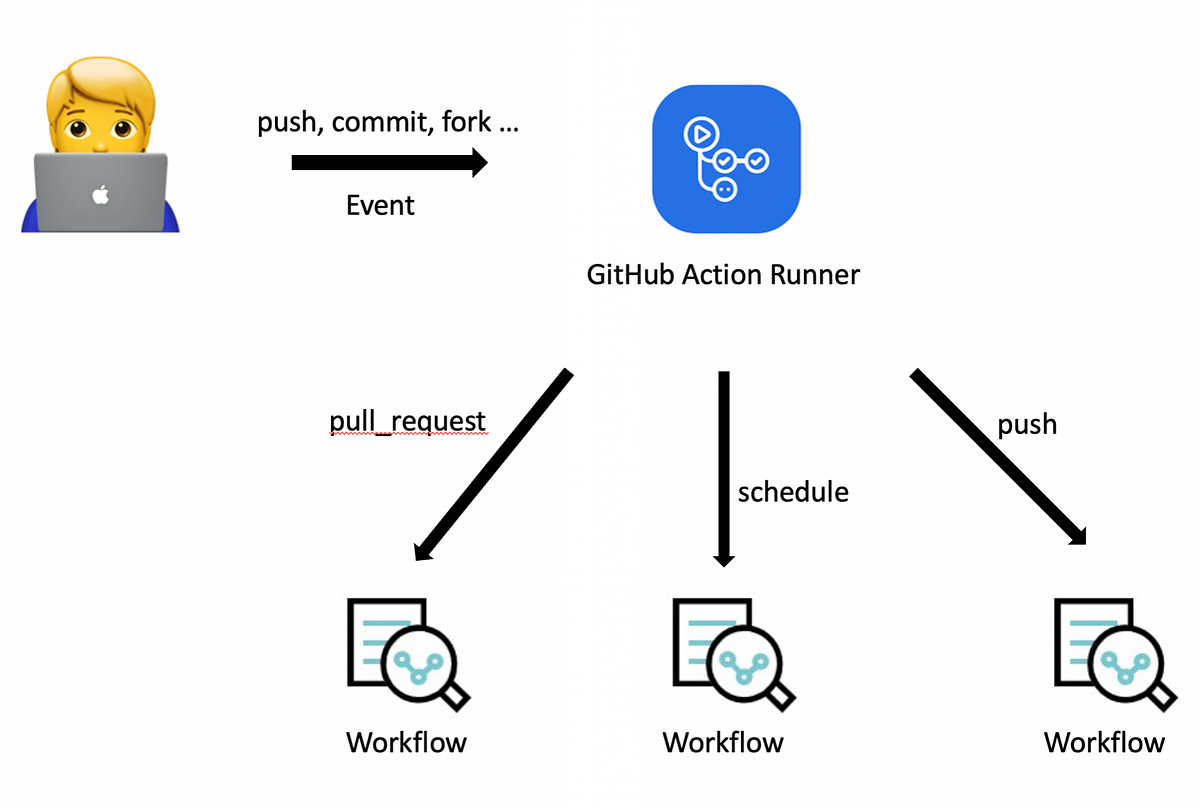

네이버 예약·주문 팀은 GitHub Actions를 도입해 CI/CD와 개발 자동화를 효과적으로 구현했습니다. 다양한 워크플로우와 Marketplace 액션 활용 사례를 통해 개발 효율성을 크게 향상시킨 경험을 공유합니다.

4월 6일

네이버 G플레이스AI개발 팀은 MinIO를 활용해 머신러닝 데이터 아카이빙 스토리지를 구축하고, 장애 대비를 위한 HA 및 DR 전략을 수립했습니다. 백업 자동화와 확장성 검증을 통해 데이터 유실 최소화와 안정적인 서비스 운영을 실현했습니다.

2월 10일

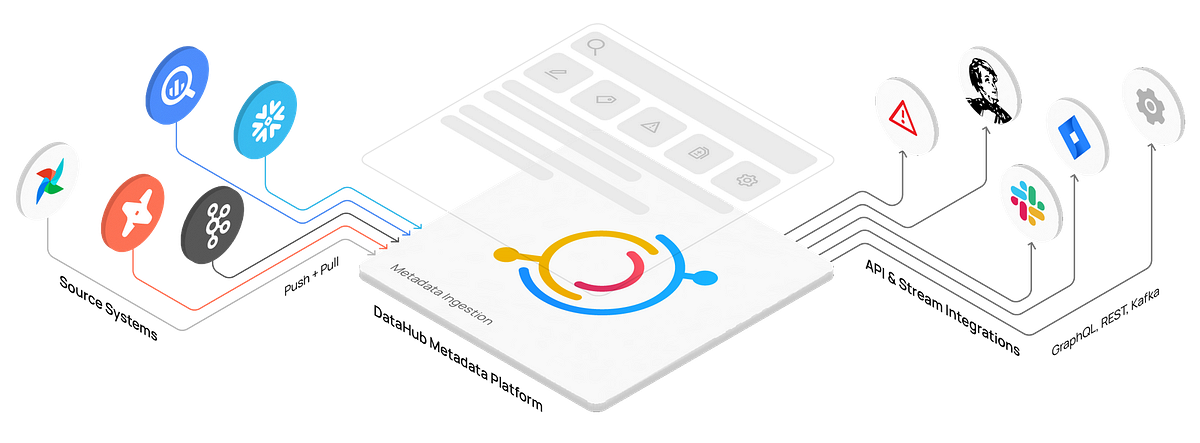

DataHub 오픈소스에 Protobuf 중첩 메시지 주석 정보를 UI에 표시하는 기능을 기여했습니다. 협업과 테스트 과정을 거쳐 기능을 성공적으로 구현하고 향후 추가 개선도 계획하고 있습니다.

2월 2일

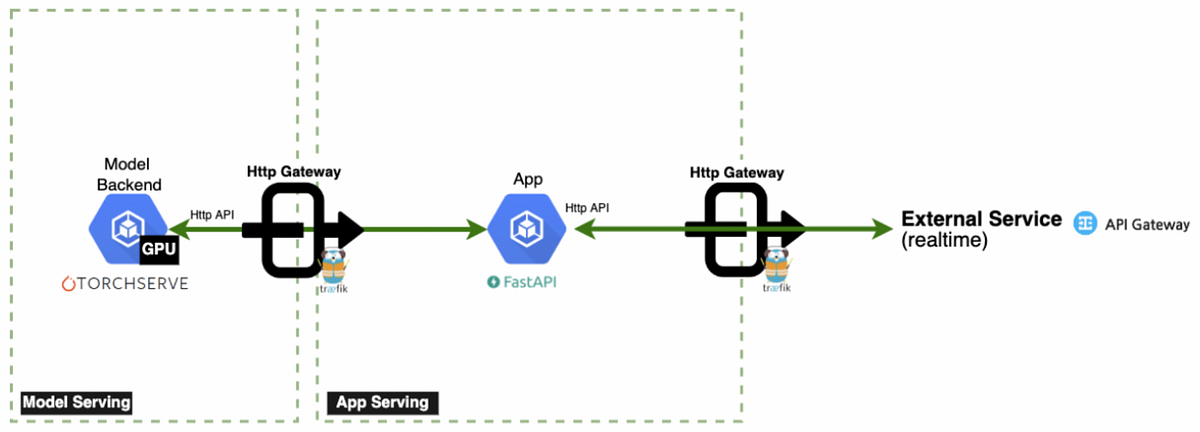

NAVER GLACE AI 개발팀은 글로벌 O2O 서비스에 맞춘 NLP와 Computer Vision 기반 다양한 AI 모델을 개발 및 운영합니다. 이들은 전용 LLM인 PlaceLM 개발과 함께 효율적인 모델 운영과 무중단 배포 체계를 갖추어 서비스 품질을 높이고 있습니다.

11월 18일

네이버 플레이스 데이터개발 팀은 Hive 사용량 통계 레포트를 개발하여 하둡 플랫폼의 효율적 운영을 지원합니다. 로그 분석과 Spark 기반 처리, 실시간 데이터 수집, 시각화 도구를 활용한 운영 현황 공유를 통해 시스템 개선을 도모합니다.

끝